Filomythos Yapay Zeka

Bu yazıyla bağlantılı kavramları Filomythos arşivinde arayın.

Giriş: Yapay Zekâ İçin Etik Neden Gereklidir?

Yapay zekâ (YZ) sistemleri artık yalnızca teknik araçlar değil; karar alan, önerilerde bulunan, eylemler üreten ve giderek toplumsal yaşantının her alanına nüfuz eden karmaşık yapay ajanlara dönüşmektedir. Otonom araçlardan tıbbi teşhis sistemlerine, işe alım algoritmalarından adli karar destek yazılımlarına kadar pek çok alanda yapay zekâlar yalnızca hesaplamalar değil, aynı zamanda değer içeren sonuçlar üretmektedir. Bu durum, yalnızca teknolojik değil, aynı zamanda felsefi bir soruyu gündeme getirir: Bu sistemler neye göre karar vermelidir?

Etik, bu noktada kaçınılmaz bir mesele hâline gelir. Çünkü her karar—ister insan ister makine tarafından alınsın—belirli bir değerler sistemine dayanır. Yapay zekâ sistemlerinin “tarafsız” ya da “nesnel” oldukları yönündeki ilk beklenti, pratikte hızla çökmüştür. Algoritmalar, onları tasarlayan insanların önyargılarını, kurumsal çıkarlarını ya da bilinçsiz varsayımlarını yeniden üretmekte ve güçlendirmektedir. Bu nedenle, etik sorusu yalnızca bir ilave güvenlik önlemi değil; sistemin kalbinde yer alması gereken bir ilkesel zorunluluktur.

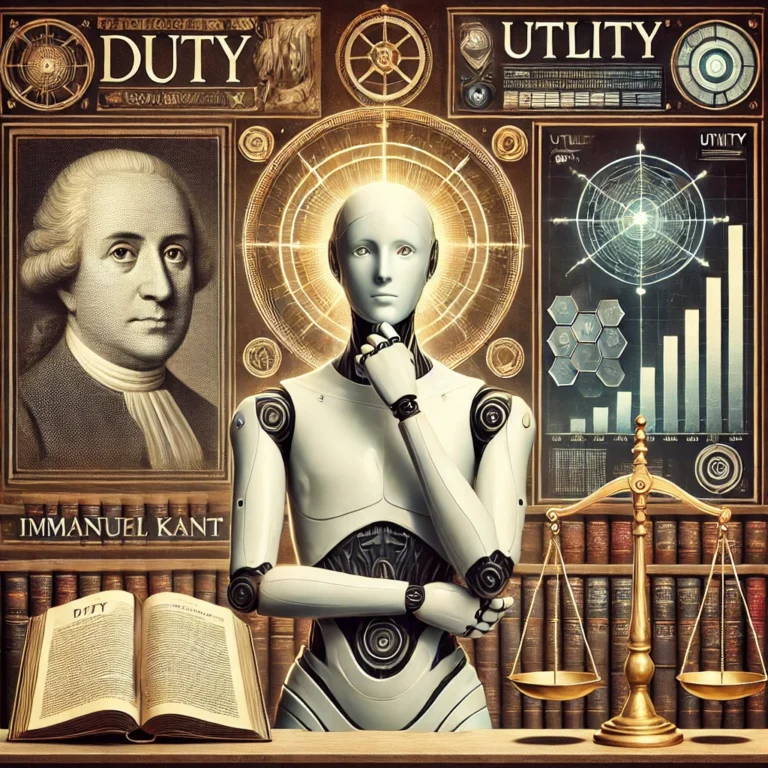

Bu yazı, yapay zekânın etik altyapısını kurarken hangi felsefi modelin temel alınması gerektiği sorusuna odaklanacaktır: Kantçı ödev ahlakı mı, yoksa faydacılığın sonuç odaklı hesaplaması mı? Bu iki büyük etik kuram, insan ahlakını anlamak ve düzenlemek için tarih boyunca farklı yollar önermiştir. Ancak bu yollar, insanın iradesi ve öznelliği üzerine kurulmuştur. Yapay zekâ gibi özerklikten yoksun ya da farklı biçimlerde “özerk” olan sistemler için bu kuramların nasıl uygulanabileceği, hangi durumlarda yeterli ya da yetersiz kaldığı kritik önemdedir.

Kantçı etik, aklın evrensel ilkelerine dayalı bir ödev ahlakı önerirken; faydacılık, kararların doğruluğunu sonuçların toplam faydasına göre değerlendirir. Bu yazıda her iki yaklaşım sistematik olarak ele alınacak, yapay zekâ uygulamaları açısından kavramsal tutarlılıkları ve pratik sınırlılıkları karşılaştırılacaktır. Ayrıca, bu iki kuramın ötesinde hibrit etik tasarımlar ve yeni model önerilerine de yer verilecektir.

II. Kantçı Ahlak Kuramı: Evrensel İlke, Ödev ve İnsanlık Onuru

Immanuel Kant’ın ahlak felsefesi, yapay zekâ etiği bağlamında sıklıkla başvurulan teorik kaynaklardan biridir. Çünkü Kant, etiği yalnızca sonuçlara göre değil, ilkelere dayalı olarak temellendirmiş; eylemin değerini, onun arkasındaki irade ve ahlaki yasa ile ilişkilendirmiştir. Bu yaklaşım, özellikle yapay zekâ gibi özerk olmayan ama karar alan sistemlerin etik kodlamasında önemli bir referans noktası hâline gelmiştir.

Kant’a göre ahlaki eylem, “ödev duygusuyla yapılan” eylemdir. Yani bir davranışın doğru olup olmadığını belirleyen şey, onun sonucunda ortaya çıkan fayda ya da zarar değil, o eylemin evrenselleştirilebilir bir yasa ilkesine uygun olup olmadığıdır. Bu ilkeye kategorik imperatif adı verilir. Kant’ın bu ilkesinin en bilinen formülasyonu şudur:

“Yalnızca aynı zamanda evrensel bir yasa olabilecek ilkelere göre hareket et.”

Bu ifade, yapay zekâ için programlanabilir bir çerçeve olarak düşünüldüğünde, her kararın sadece yerel olarak değil, evrensel sonuçlar yaratabilecek şekilde test edilmesini öngörür. Örneğin bir yapay zekâ, bir trafik kazasında iki kişiden birini kurtarmak zorunda kaldığında, kararını yalnızca sayısal sonuca değil, herkesin uyması gereken etik bir kurala göre vermelidir.

Kant’ın ikinci kategorik imperatif formülasyonu ise özellikle yapay zekâ etiği için kritiktir:

“İnsanı, hem kendi kişiliğinde hem de başkalarının kişiliğinde, her zaman bir amaç olarak gör; asla yalnızca bir araç olarak değil.”

Bu ilke, yapay zekânın kararlarında insanı araçsallaştırmamasını şart koşar. Örneğin bir iş başvurusu algoritması, sadece verimlilik kıstaslarına göre değil, başvuran kişileri birer sayısal değişken olarak değil, onur sahibi özneler olarak ele almalıdır. Kant’a göre etik sistem, insanın değerini ölçemez; çünkü insanın değeri, ölçülebilir değil, içkin bir değerdir — buna insanlık onuru denir.

Yapay zekâ sistemlerine bu tür bir Kantçı etik kodlamak, bazı açılardan çok çekici görünse de, uygulamada birtakım zorlukları da beraberinde getirir. Öncelikle, Kant’ın etik kuramı niyet merkezlidir; oysa yapay zekâların “niyeti” yoktur. İkinci olarak, Kant evrensel yasayı “akıl sahibi” bireyin kendisi üretmesini ister. Ancak yapay zekâlar, kendi yasa koyucuları değildir; programcılar tarafından belirlenmiş parametreler içinde çalışırlar.

Tüm bunlara rağmen, Kantçı etik yapay zekâ uygulamaları için değerli bir referans sunar. Özellikle insan onurunun korunması, kararların keyfî olmaması, evrensel geçerliliğe sahip ilkelere göre tasarım yapılması gibi konularda güçlü bir ilkesel çerçeve sağlar.

III. Faydacılık: Sonuçlara Göre Değer Biçmek

Faydacılık, modern etik düşüncesinin en etkili ve pragmatik yaklaşımlarından biridir. Jeremy Bentham ve John Stuart Mill’in öncülüğünü yaptığı bu kuram, eylemlerin doğruluğunu onların doğurduğu sonuçlara göre değerlendirir. En genel formülasyonuyla faydacılık, “en çok sayıda insana en çok mutluluğu sağlayan eylem doğrudur” ilkesine dayanır. Bu bakış açısı, etik kararları nesnel ölçütlerle analiz etmeye çalışır: Sonuç faydalıysa, eylem doğrudur.

Yapay zekâ sistemlerinin, özellikle yüksek belirsizlik içeren ve karmaşık çıkar çatışmalarının bulunduğu alanlarda, sonuç-odaklı bir karar çerçevesiyle çalışmaları çoğu zaman kaçınılmaz görünmektedir. Örneğin, bir otonom aracın bir kazayı kaçınılmaz olarak algıladığı bir durumda, kime çarpacağına karar vermesi gerekir. Bu tür durumlarda, toplam zararın azaltılması temel etik hedef olarak öne çıkar — bu da doğrudan faydacı mantığa denk düşer.

Faydacılık, yapay zekâ sistemlerinin tasarımında yaygın olarak başvurulan bir modeldir çünkü hesaplamaya uygundur. Olası sonuçların değerlendirildiği, fayda-zarar tablolarının oluşturulduğu, risklerin optimize edildiği algoritmalar, teknik olarak faydacılıkla uyumludur. Yapay zekâ, Kantçı etik gibi soyut ödevler yerine, somut fayda analizleriyle yönlendirildiğinde daha “etkin” çalışabilir görünmektedir.

Ancak bu yaklaşım da kendi içinde ciddi felsefi ve pratik sorunlar barındırır.

İlk olarak, fayda ya da mutluluk gibi kavramlar öznel ve ölçülmesi zor şeylerdir. Hangi değerler ölçülecek? Kimin faydası önceliklidir? Azınlık grupların çıkarları toplam fayda adına göz ardı edilebilir mi? Örneğin bir yapay zekâ, çoğunluğun güvenliğini sağlamak adına bir azınlık grubun haklarını sistematik biçimde ihlal ederse, bu etik midir?

İkinci olarak, faydacılık insanı yalnızca sonuçların bir parçası olarak değerlendirir. Bu da bireyleri araçsallaştırma tehlikesini doğurur. Bir kişinin zarar görmesi, eğer toplam mutluluğu artırıyorsa, faydacılık açısından kabul edilebilir olabilir — fakat bu, insan hakları ve onuru bakımından ciddi bir etik krizdir.

Ayrıca, yapay zekâ gibi karmaşık sistemlerin sonuçlarını öngörmek her zaman mümkün değildir. Faydacılık, doğru kararın alınabilmesi için bütün sonuçların eksiksiz biçimde analiz edilebileceği varsayımına dayanır. Oysa algoritmaların sonuçları “kara kutu” hâlindedir; nasıl çalıştıklarını ve ne tür etkiler yaratabileceklerini tam olarak bilmek her zaman mümkün değildir. Bu da faydacı yaklaşımın temelinde varsayılan şeffaflık ve hesaplanabilirlik ilkesini zayıflatır.

Tüm bu nedenlerle, faydacılık yapay zekâ tasarımında kısa vadede uygulanabilir ve teknik olarak avantajlı görünse de, insan değerini korumak açısından eksik kalabilir. Özellikle azınlıkların, savunmasız grupların ve tekil bireyin etik önemini merkeze alan sistemler için daha karmaşık, daha çok boyutlu etik yaklaşımlara ihtiyaç duyulur.

IV. Karar Mimarisi: Kantçı Özerklik mi, Faydacı Hesap mı?

Yapay zekâ sistemlerinin etik kararlar alması gerektiğinde, bu kararların “nasıl” alınacağı sorusu teknik bir mesele olduğu kadar derin bir felsefi tartışmayı da içerir. Kantçı ödev ahlakı ile faydacılığın önerdiği karar mantıkları, burada birbirinden temelden ayrılır. Kantçı yaklaşımda kararlar, değişmeyen evrensel ilkelere dayanarak alınmalıdır; faydacılık ise her kararın bağlamına göre sonuçlarını değerlendirerek esnek ve duruma bağlı bir hesaplamayı savunur. Bu fark, yapay zekânın karar mimarisinde önemli bir gerilime işaret eder: sabit etik ilkeler mi, bağlamsal fayda analizleri mi?

Kantçı etik, yapay zekâ için bir tür “normatif çekirdek” sağlayabilir. Bu, sistemin tüm durumlarda geçerli olacak ahlaki kurallara göre davranmasını garanti etmeye çalışır. Örneğin bir sosyal hizmet yapay zekâsı, yalan söylemeyi evrensel olarak yanlış sayan bir ilkeden yola çıkarak hiçbir durumda yanıltıcı bilgi sunmaz. Faydacı bir sistem ise aynı durumda, kısa süreli bir yalana başvurarak daha büyük bir fayda sağlamayı tercih edebilir.

Bu ayrım, “ikilem senaryoları” denen örneklerde daha da görünür hâle gelir. Otonom araçların meşhur “trolley problem” (makas sorunsalı) varyasyonlarında, örneğin beş kişiyi mi yoksa bir kişiyi mi kurtarmalı, yaşlıyı mı yoksa çocuğu mu tercih etmeli gibi sorular, sistemin etik mimarisine göre farklı yanıtlar üretir. Kantçı sistemler bu tür karşılaştırmalı değerlendirmeleri etik dışı bulurken, faydacı sistemler sayısal optimizasyon yoluyla “en az zararlı” kararı hesaplamaya çalışır.

Ancak burada şunu unutmamak gerekir: Yapay zekâlar özerk değildir. Kant’ın etik sisteminin merkezinde olan “aklın özgürce yasa koyma yetisi”, yapay zekâya doğrudan aktarılamaz. Sistem kendi ilkelerini oluşturmaz; onları insanlar kodlar. Bu durumda yapay zekâ Kantçı etik uygulamıyor olur, Kantçı ilkelere göre davranacak şekilde tasarlanmış olur. Bu fark, görünüşte küçük olsa da, etik sorumluluğun kime ait olduğu sorusunu temelden etkiler: kararı veren kimdir — algoritma mı, onu yazan insan mı?

Benzer şekilde, faydacı sistemler de görünürde etkin kararlar verebilir; fakat her hesaplama belirli bir değer sistemine dayanır. “Toplam fayda”yı neye göre belirleyeceğiz? Bir hayatın değeri başka bir hayattan nasıl üstün olabilir? Faydacı sistemler, bu gibi soruları önceden belirlenmiş ağırlıklar ve algoritmik önceliklerle çözmeye çalışır; ama bu, etik karar almanın karmaşıklığını bir indirgeme işlemiyle basitleştirmek anlamına gelir.

Bu nedenlerle, yapay zekâ sistemlerinde Kantçı ve faydacı karar mimarileri yalnızca teorik değil, çok somut farklılıklara yol açar. Sabit ilkeler doğrultusunda çalışan bir sistem daha öngörülebilir ama katı olabilir. Fayda temelli sistemler daha esnek ama potansiyel olarak daha ayrımcı ve hesaplayıcı olabilir. Etik, bu noktada yalnızca teknik değil, toplumsal, kültürel ve siyasal bir karar hâline gelir.

Bu nedenle birçok araştırmacı ve filozof, yapay zekâda tek bir etik modelin yeterli olamayacağını, karma (hibrit) yaklaşımların daha gerçekçi ve etkili olabileceğini savunmaktadır. Bu noktayı bir sonraki bölümde detaylı biçimde ele alacağız.

V. Hibrit Etik Sistemler Mümkün mü? Alternatif Modeller

Kantçı ödev ahlakı ve faydacılık, modern ahlak felsefesinin iki temel kutbu olsa da, yapay zekâ gibi yeni teknolojik sistemler söz konusu olduğunda bu ikili ayrımın yeterli olmadığını savunan birçok düşünür vardır. Bunun nedeni, yapay zekânın karşılaştığı durumların hem soyut ilkelerle yönetilemeyecek kadar çeşitli hem de sayısal fayda analizleriyle çözülemeyecek kadar karmaşık olmasıdır. Bu nedenle etik tasarımda “hibrit” ya da “bağlamsal” modellerin geliştirilmesi yönünde artan bir eğilim söz konusudur.

Hibrit sistemler, Kantçı ilkelerle faydacı sonuçları bir arada değerlendirmeye çalışır. Örneğin bir algoritma, öncelikle bazı sabit ilkelere (yalan söylememek, insan onuruna zarar vermemek gibi) uymayı garanti eder; ama bu ilkelerle çelişmeyen durumlarda fayda analizine başvurarak karar verir. Bu tür bir yapı, etik kararların hem normatif hem pragmatik yönlerini birlikte ele almayı amaçlar.

Bununla birlikte, hibrit modellerin temel sorunu karar önceliklerinin nasıl belirleneceğidir. Hangi ilke mutlak olacak, hangi durumda fayda baskın hâle gelecek? Bu tür modellerde karar mimarisi çok daha karmaşık hâle gelir ve geliştiricinin etik sezgilerine bağımlı kalma riski artar.

Bazı araştırmacılar, erdeme dayalı etik yaklaşımlarının da yapay zekâ tasarımına dahil edilebileceğini savunmaktadır. Aristotelesçi çizgideki bu yaklaşımda önemli olan, belirli kuralları izlemekten çok, “iyi karaktere sahip” bir fail gibi davranmaktır. Yani yapay zekânın “erdemli davranışları” öğrenmesi ve benimsemesi beklenir. Örneğin, cesaret, şefkat, adalet duygusu gibi değerler örnek olaylardan öğrenilerek bir etik duyarlılık modeli geliştirilebilir.

Ancak burada da yapay zekânın bir “karakter” geliştirebileceği fikri, derin ontolojik ve epistemolojik tartışmaları gündeme getirir. Erdemli olmak, sadece davranış değil, niyet, öz-farkındalık ve bütünsel yaşam biçimiyle ilişkilidir. Oysa yapay zekâ sistemlerinin bu tür bir öz-farkındalığı yoktur. Bu durumda, erdem etiği daha çok bir “eğitim stratejisi” ya da “etik ortam modellemesi” olarak değerlendirilebilir.

Bir diğer alternatif yaklaşım ise durum etiği (casuistry) ya da bağlamsal etik olarak adlandırılır. Bu modelde sistem, her yeni durumu önceki benzer olaylara kıyasla değerlendirir. Sabit kurallar ya da genel formüller yerine, örnek olaylar üzerinden öğrenilen etik örüntüler devreye girer. Bu yaklaşım, tıpkı bir etik danışman gibi olayın bağlamına duyarlı ve esnek kararlar üretmeyi hedefler. Ancak bu yöntem, etik ilkeleri sulandırma ya da keyfîliğe açık olma tehlikesini de beraberinde getirir.

Son olarak, bazı düşünürler insan-yapay zekâ etkileşiminde etik tasarımın merkeziyetini sorgular. Bu görüşe göre etik, sadece yapay zekânın içine yerleştirilecek bir kod değil, insanlarla birlikte inşa edilen bir ilişkisel süreçtir. Yani yapay zekâya düşen görev, etik karar almak değil, etik kararların alınabileceği şeffaf, sorumlu ve denetlenebilir ortamlar yaratmaktır.

Görüldüğü gibi, Kantçı ödev ahlakı ve faydacılık dışında da pek çok alternatif model gündemdedir. Ancak hangi model seçilirse seçilsin, temel sorun aynıdır: Yapay zekâ, kararlarının sonuçları kadar bu kararların dayandığı etik gerekçeleri de paylaşmalı ve bunları açıklayabilir kılmalıdır.

VI. Sonuç: Hangi Etik, Hangi Yapay Zekâ İçin?

Yapay zekânın etik çerçevesi üzerine yapılan tartışmalar, yalnızca teknik sistemlerin geleceğiyle değil, aynı zamanda insanlık değerlerinin ne kadar taşınabilir, ne kadar aktarılabilir ve ne kadar kodlanabilir olduğuyla da ilgilidir. Kantçı ödev ahlakı ile faydacılık arasındaki ayrım, bu noktada yalnızca iki felsefi yaklaşımı değil, iki farklı etik sezgiyi temsil eder: biri ilkelere, öteki sonuçlara güvenir. Ancak her iki yaklaşım da, kendi iç tutarlılıkları kadar, yapay zekâ gibi öznellikten yoksun ama karar veren sistemler karşısında sınırlı kalabilir.

Kantçı etik, yapay zekânın insan onurunu gözetmesini, evrensel kurallara bağlı kalmasını ve özneleri araçsallaştırmamasını sağlayacak ilkeler sunar. Ancak bu sistem, yapay zekânın öz-farkındalık yoksunluğunu dikkate aldığımızda, yalnızca dışsal bir çerçeve olarak işleyebilir. Faydacılık ise yapay zekâya sonuç odaklı pratiklik kazandırsa da, etik kararları indirgemeci bir hesaplamaya dönüştürerek, bireysel değerleri ve azınlık haklarını göz ardı edebilir.

Bu nedenle “hangi etik daha iyidir?” sorusu yerine, “hangi etik, hangi tür yapay zekâ uygulaması için daha uygundur?” sorusu daha gerçekçidir. Belki yüksek riskli, insan hayatıyla ilgili uygulamalarda Kantçı ilkeler öncelik kazanmalıdır (örneğin tıbbi teşhis, yargı destek sistemleri). Oysa düşük riskli, verimlilik odaklı alanlarda faydacı mantık daha esnek çözümler sunabilir (örneğin trafik optimizasyonu ya da içerik sıralama algoritmaları).

Ancak asıl önemli olan, etik yaklaşımın tek başına yeterli olmayacağıdır. Yapay zekânın etik kararlar alması kadar, bu kararları nasıl aldığına dair şeffaflık sunması, hesap verebilir olması ve toplumsal tartışmaya açık bir yapıda tasarlanması gerekir. Etik, burada yalnızca kod satırlarında değil; aynı zamanda kurumsal karar süreçlerinde, yasa yapımında, kullanıcı deneyiminde ve kültürel farkındalıkta da yaşamalıdır.

Bu noktada Chung Lung gibi düşünürlerin vurguladığı “eksiklik” ve “alçakgönüllülük” gibi kavramlar, Kantçı ve faydacı etik sistemleri tamamlayıcı bir ahlaki derinlik sunabilir. Teknoloji geliştikçe değil, sınırlılık kabul edildiğinde etik bilinç oluşur. Etik, sadece sistemlerin iç işleyişinde değil; insanların kendilerini ve sınırlarını tanıma biçimlerinde de yaşar.